Googleが新たなテキスト画像AI生成モデル「Muse」を発表

AIにテキストを入力するだけで誰でもすぐにイラストが作成できる、テキスト画像AI生成モデルが続々と登場しています。中でも注目を集めているのが「Stable Diffusion」やOpenAIの「DALL-E 2」などが先行する画像生成AIです。画像生成AIの種類や違いについては別記事「「画像生成AI」はどんな種類や違いがある?「Midjourney」「DALL・E2」「Stable Diffusion」などを比較」をご参照ください。Googleもすでに「Imagen」と「Parti」という画像生成AIを発表していますが、2023年1月に発表した「Muse」はどのような点が先行するAIモデルと異なるのでしょうか。

従来の画像生成AIよりも高速化

1画像(512×512)あたりの生成時間は、Stable Diffusion 1.4の3.7秒に対し、Museは1.3秒となっています。高速化を可能にした理由としては、従来の拡散(diffusion)モデル(ノイズからスタートし、徐々にノイズを除去していくことで、データを生成するモデル)と違い、量子化された画像トークン(学習用画像のセット)を使用することでサンプリングの反復回数を減らしていることで効率を高めているためです。既存の画像を編集する機能

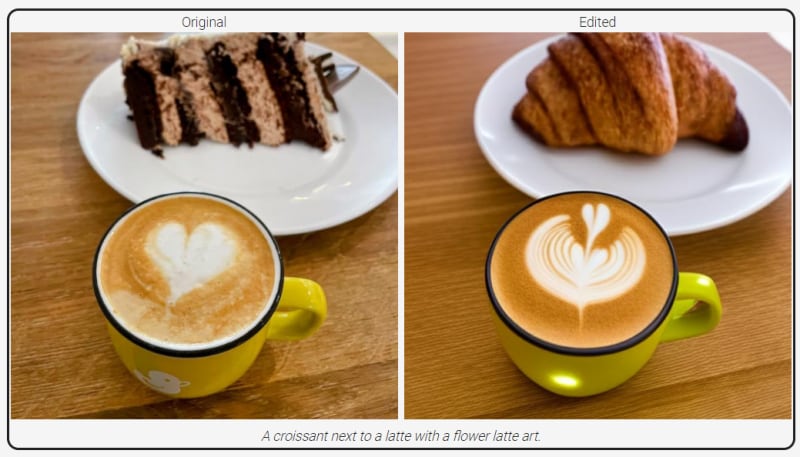

従来の画像生成AIのようにゼロから画像を生成するだけでなく、既存の画像を編集することも可能です。 「皿に置かれたケーキとカップに入ったカフェオレ」の写真を元画像として用意し、そこに「花のラテアートが描かれたカフェラテの隣にあるクロワッサン(A croissant next to a latte with a flower latte art.)」というテキストを入力することで、皿やカップはそのままにクロワッサンと花のラテアートの部分だけが置換されています。 同様に、「赤ワインのグラスとキャップの隣にある赤ワインのボトル」の写真を元画像として用意し、そこに「白ワインのグラスとコルクの隣にある白ワインのボトル(A bottle of Pinot Grigio next to a glass of white wine and a cork.)」というテキストを入力することで、赤ワインが白ワインに、キャップはコルクに置換されています。マスクを使用した修正も可能

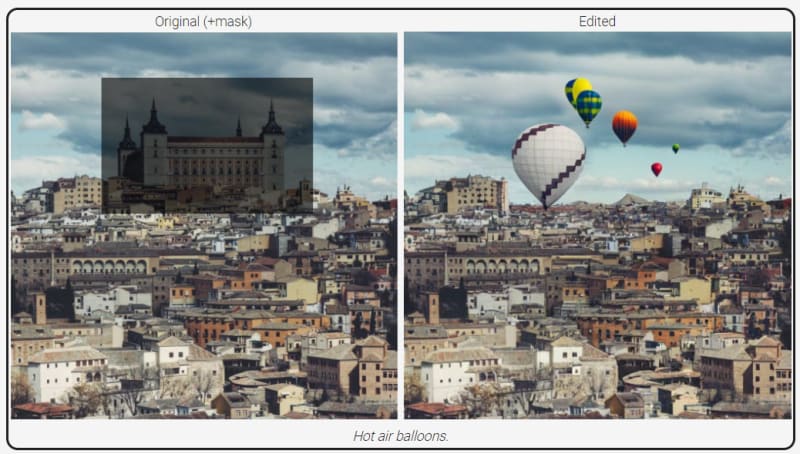

画像の一部の要素を指定する「マスク」機能を使用し、マスク内だけを修正する「Inpainting」や、マスク外だけを描き足す「Outpainting」を行うことができます。 マスクで指定された「城」の部分が指定されたテキスト「熱気球(Hot air balloons)」通りに置換されています。 マスクで指定された「見晴らし小屋」の部分はそのままに、マスク外の部分が指定されたテキスト「美しい秋の木々、湖の上の見晴らし小屋(Beautiful fall foliage; the gazebo is on a lake)」通りに置換されています。従来の画像生成AIはゼロから画像を生成することに主眼が置かれていますが、完全に意図通りの画像を作成するのはまだまだ困難です。しかし、「Muse」ではこのように既存の画像を簡単に編集することが可能なため、ゼロベースの画像生成よりも意図通りのものを作成することが容易となっています。その簡易さから、Photoshopのような画像編集ツールに取って代わる可能性を秘めています。

Museは現状未公開

現状GoogleはAIのデータセットにバイアスがかかる危険があるとして、一部(Imagenのみ米国限定でベータ版が利用可能)を除いてMuse等を公開していません。これは一般公開すると、AIが学習する素材に偏りが生じ、的確な画像を生成できなくなるとGoogleが判断しているということです。

今後Museが一般公開されたとき、画像生成のみならず、画像編集の分野でも大きな変化がもたらされそうです。